生成AIファーストの世界のサイバーセキュリティ戦略

Written byWILL HORYN

いつの時代も、新しい技術やサービスが誕生する時には新しいリスクも見え隠れするものです。それはITの世界においても例外ではありません。インターネットの誕生と普及、次にポータブルPCやスマートフォンなどのモバイルデバイスと通信の進化と普及、そして、我々はまさにクラウドソリューションの普及と拡大の波の中にいます。その波の中で、これまでに経験した変化をはるかに凌駕することが予見される技術への対応、つまり企業でのAIやLLMの実活用の試行錯誤が本格的に始まりました。

AIやLLMを企業が活用する上でのリスク、それはサイバーセキュリティーリスクです。AIやLLMの活用は企業の意思決定など上流から日々の活動まで広範囲となることが予見されます。また、既存のシステムとの連携により大きな成果をあげることも予見されています。つまり、潜在的なリスクはとても広範囲に影響を与える可能性があるのです。「活用したいがリスクがある」このジレンマに世界の企業はどのような戦略をとっているのか? Geodesic Capital 投資チームのウィル・ホリンがわかりやすく図式化を試みています。これからの方針を検討するとき、きっとお役に立てると思います。

ーGeodesic Japan ビジネスデベロップメント担当ディレクター 大塚 孝之

ジェネレーティブAI(「生成AI」)は今、エンタープライズテクノロジーで最も話題となっている用語ですが、それには理由があるのです。サイロ化された独自データを活用できるようにし、技術を活用する能力に依存せず新たな能力を引き出すことで、組織全体の従業員をレベルアップさせる可能性がこのソフトウェア技術にはあり、将来性があることは目に見えて明らかです。しかし、企業が実験段階から徐々に本番環境の利用に移行するにつれて、生成AIをめぐる盛り上がりは、同じく差し迫った懸念事項である「サイバーセキュリティリスク」によって打ち消し合う方向に向かいがちです。テクノロジーの進化はすべてにおいて、新たな脆弱性、リスク、考慮すべき事項、そして解決策の模索(これについては後ほど言及します)をもたらすものです。クラウドへの移行の時に起きたことは、このことを的確に示しており、SASE *1(Netskope、Zscaler)、クラウドセキュリティポスチャー管理 *2(Wiz、Orca、Palo Alto Networks)、 IAM *3(Okta、Transmit Security)など、サイバーセキュリティのまったく新しいカテゴリーを盛り立てる触媒のような作用を及ぼしてきました。

生成AIもその例外ではなく、企業は積極的に懸念を表明しています。HiddenLayerの第1回AIの脅威に関するランドスケープレポートによると、「ITセキュリティリーダーの89%がサードパーティのAIツールやモデルの統合に関して、セキュリティの脆弱性を懸念しており、75%がこうしたサードパーティのAI統合が、既存の脅威よりも大きなリスクをもたらす」と考えています。最近のシスコの世論調査では、回答者の50%以上が、AI/ML導入における最大の難題として、統合や日常管理などの運用面よりもセキュリティ上の懸念(特にデータプライバシーやデータ損失防止に関するもの)を挙げています。生成AIはアタッカーによって攻撃的に使用される可能性もあり、ガートナーは、2025年までに自律型エージェントが「スマートマルウェア」を生み出す高度なサイバー攻撃を引き起こすと予測しています。

大手企業から寄せられたコメントは、社内のセーフガードの欠如や、予算の配分不足など、この問題への注目度の高さを示しています。

-

- 上場サイバーセキュリティベンダーの製品管理ディレクター:「AIシステムの構築における成熟度の低さ(には最も驚かされました)。ソフトウェアには、より確立されたベストプラクティスがあります。AIの理解と成熟は未だ整っておらず、使用・採用する際にリスクをもたらします。基礎となるモデルに脆弱性が1つでもあれば、すべてのダウンストリームアプリケーションが脆弱になります」

- 大手クルーズ客船運行会社のCISO:「生成AIは企業のアクセラレーターになる可能性がありますが、正しく扱われなければIPを明け渡してしまう可能性があります」

- 大手DC&コロケーションプロバイダー*4 のシニア プリンシパル データサイエンティスト:「生成AIにより、ユースケースのリクエストが急増しました。LLMのスピンアップに対する障壁は低くなったため、セキュリティの必要性が高くなっています。(生成AIのセキュリティには)多くの注目が集まっていますが、現在の予算は限られています。今後、予算配分が拡大することを期待しています」

生成AI関連のリスクは、既存の攻撃経路の増強と新たな脆弱性の悪用という主にこの2つの形で現れます。前者については、フィッシング、マルウェア、DDoS攻撃(分散型サービス拒否攻撃 ))*5 などのよく知られた脅威が、AIによって増強され、堅牢なソーシャルエンジニアリングやディープフェイク、メタモーフィック型マルウェア、権限を得た脅威アクターなど、より高度な攻撃につながります。後者については、生成AIの採用の増加に伴い、データプライバシー、法規制遵守、シャドウAI、LLMおよびアプリケーションセキュリティといった、多くの新たな難題が顕在化しています。特に、データポイズニング、プロンプトインジェクション *6、LLM DoSなどの新しい手口により、機密データの流出、操作された出力の強制、モデルの停止、推論コストの膨大な増加が起きています(LLM関連の広範なリスクについては、OWASPのトップ10リストを参照ください)。Anthropicは最近「ジェイルブレイク」として知られるプロンプトインジェクションの一形態についてこの記事で取り上げ、LLMと関連アプリケーションを脆弱にするたくさんある方法のうちの1つを説明しました。

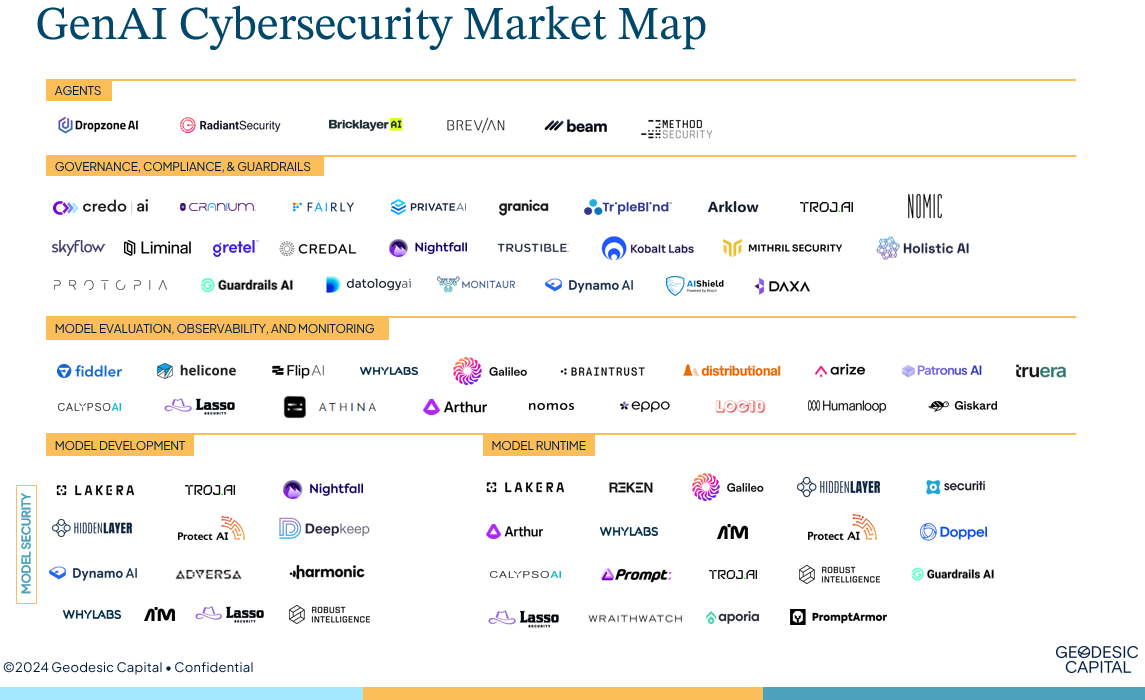

幸いなことに、楽観的な見方もあります。数多くの起業家たちが市場からの呼びかけに応え、これらの新たな難題に対処するソリューションを開発しています。現在、生成AIサイバーセキュリティスタックのさまざまなレイヤーで活動している、スタートアップベンダーをご紹介します。下記の図表をご確認ください。この分野の進化の速さを考えると、今から数か月後でも状況は確実に変わっているはずですが、(皆様がこの記事を読んでいる時点でも)この市場マップが、企業のニーズに応えてベンダーが取り組んでいる活動のレベルや主要領域を示していることを願っています。

ここからは、市場を4つの主要なサブセクター(1つのボーナスエリアを含む)に区分し、詳しく説明します。現在利用可能な機能の範囲を考慮して、一部のベンダーが複数のサブセクターにまたがっていること気に留めておいてください。ベンダーは、企業が生成AI関連のサイバーセキュリティのニーズすべてを一箇所で管理できるエンドツーエンドのプラットフォームアプローチの提供を目指しているため、機能セットは今後も統合されていくと思われます。

-

- セキュリティレイヤーは、「モデルの開発」と「モデルのランタイム」という2つの主な重点領域に分かれています。

- モデルの開発は、生成AIサイバーセキュリティスタックの最も上流のコンポーネントであり、モデルが本番環境に投入される前にリスクから保護します。これには、侵入テスト、モデルスキャン、脆弱性評価、データ検証とセキュリティ(データポイズニングから保護)、モデルサプライチェーンセキュリティ、シャドウAIの検出などの機能により、潜在的な脆弱性に対してモデルを強化し、基礎となるデータの忠実性を確保することが含まれます。Protect AIやHiddenLayerなどのベンダーは、本番前環境の安全性を確保するための堅牢なモデルスキャンやリスク検出などのさまざまな機能を提供しています。脆弱性や障害は、すべてのダウンストリームアプリケーションに波及するため、モデルのセキュリティを事前に確保することが重要です。

- モデルのランタイム(実行時)に対応するベンダー(Robust IntelligenceやLakera)は、内部または外部のユースケースのいずれであっても、本番環境において、モデルとその関連する出力を保護します。重要な機能には、LLMファイアウォール(モデルの入力と出力の両方)とリアルタイムの検出と応答が含まれます。LLMファイアウォールは、リクエストがモデルに到達する前にフィルタリングや拒否したり、最後の手段として不適切なモデルの応答をブロックしたりできるため、プロンプトインジェクション攻撃に対する防御に特に効果的です。追記 – LLMハッカーとしての腕を試してみたい場合は、Lakeraのプロンプトインジェクションチャレンジをチェックしてください(私は本業に専念します)。

- セキュリティレイヤーは、「モデルの開発」と「モデルのランタイム」という2つの主な重点領域に分かれています。

- 「評価、可観測性、監視」の分野があることで、企業は、生成AIモデルが期待どおりに実行され、信頼性を維持し、長期にわたって継続的に改善されることを確認できます。これは、同じ入力でも異なる出力を生成する可能性がある、生成AIの非決定論的な特質を考慮すると大変重要なことです。これらのモデルは「ブラックボックス」の性質によりトラブルシューティングが難しいため、問題はさらに深刻です。この分野のベンダーである、ArizeとPatronus AIは、大規模なモデル評価と可観測性に焦点を当てたプラットフォームを構築しています。企業は、モデルドリフト*7 やハルシネーション*8 のリスクを軽減し、忠実度の高い出力と、基準やポリシーへのコンプライアンスを確保するために、アップタイムとパフォーマンスについて、一貫したインサイトを得る必要があります。

- 「ガバナンス、コンプライアンス、ガードレール」のサブセクターでイノベーションを起こしているスタートアップベンダーは、倫理的使用、法規制遵守、透明性、ポリシー遵守の確保に広く焦点を当てた目標を掲げ、広範な難題に取り組んでいます。これには、データプライバシー(準同型暗号化*9、差分プライバシー*10、PII(個人識別情報)秘匿化のための合成データなど)、データ損失防止、ロールベースのアクセス制御(RAG認証/認可を含む)、国際基準や地域基準に対する準拠、可監査性のための記録の確立へのアプローチが含まれます。CredoとNightfallは、この分野に取り組んでおり、一元化されたガバナンスプラットフォームとデータセキュリティに焦点を当てています。

- 上述の主要なサブセクターは、これまでのこの分野における活動の大部分を反映しており、サイバーセキュリティ担当者が、新しい脅威経路から生成AIモデルとアプリケーションを、より適切に保護できるようにするための大きな手段となります。しかし、注目を集めている次の新しい革新的な領域に「AIエージェント」があります。「AIにはAIで対抗する」という前提に基づいて構築されたエージェント型(自律的に機能する)ワークフローを使用することにより、ますます高度化するタスクを実行し、すでに多忙で人材が不足している人間のサイバーセキュリティ担当者の負担を大幅に軽減できます。例えば、Dropzone AIは、人間のアナリストが圧倒されている大量のアラートを、自律的にトリアージできる、AIセキュリティオペレーションセンター(SOC)アナリストの開発におけるパイオニアです。初期段階ではありますが、この分野は非常に有望であり、近い将来、さらに多くのベンダーがこの分野で競争することになると予想されます。

どんな規模の組織も、生成AIに起因する脅威の増大を念頭に置かなければなりません。生成AIテクノロジーの導入を選択した場合(プロプライエタリであれサードパーティであれ)、その利用が安全で、コンプライアンスに準拠し、正確で、監視されたものであることを確保するために、適切な予算を割り当てるべきです。この分野の急速な進化が続く中、企業が上記の市場マップを参照し、ベンダーと連携して生成AIサイバーセキュリティ戦略を策定することをお勧めします。

Geodesicでは、Netskope、Snyk、Tanium、Duo、Transmit Security、Pindrop、Traceableといった、サイバーセキュリティのパイオニアと提携する機会に恵まれており、次代の業界リーダーと協力できることを嬉しく思います。もしこれらの企業についてご関心がありましたら、ぜひご連絡ください。

*1 SASE:Secure Access Service Edge。IT環境におけるセキュリティ機能とネットワーク機能を1つのクラウドサービスに統合させるという、新たなセキュリティフレームワークの考え方。

*2 クラウドセキュリティポスチャー管理:クラウドベースのシステムとインフラをモニタリングして、クラウド サービス、Webアプリケーション、リソースの設定ミスやコンプライアンス違反などの潜在的な脆弱性を特定するITセキュリティ ソリューション。

*3 IAM:Identity and Access Management。「IDの管理・認証・認可」を指す言葉で、社内アプリケーションやクラウドサービスなど、企業が利用するシステムごとに設定された複数のIDを統合管理し、同時にアクセス権限の適切な管理を行うための仕組み。

*4 コロケーション:ネットワークへの常時接続環境のもとに、サーバや回線接続装置などを共同の場所に設置すること。ユーザが構築した、サーバを預かって管理保守していくサービスの事を、コロケーションサービスや、ハウジングサービスという。

*5 DDoS:「DoS攻撃(Denial of Service attack/サービス拒否攻撃)」は、ウェブサイトやサーバーに対して過剰なアクセスやデータを送付するサイバー攻撃。そして、このDoS攻撃を、対象のウェブサイトやサーバーに対して複数のコンピューターから大量に行うことを「DDoS攻撃(Distributed Denial of Service attack/分散型サービス拒否攻撃)」という。

*6 プロンプトインジェクション:生成AIを意図的に誤作動を起こさせるような指令入力を与え、提供側が出力を禁止している情報(開発に関する情報、犯罪に使われうる情報等)を生成させる攻撃。これにより、攻撃者はシステムの制御を奪ったり、機密情報を盗んだり、不正な操作を行ったりすることができる。

*7 モデル・ドリフト:モデルの減衰とも呼ばれ、データにおける変動や入力変数と出力変数間の関係における変化によりモデルのパフォーマンスが低下すること。

*8 ハルシネーション:人工知能(AI)が事実に基づかない情報を生成する現象のこと。

*9 準同型暗号化:ホモモルフィック暗号化とも呼ばれ、そのデータに対して計算を実行する能力を維持したままデータを暗号化する方式。

*10 差分プライバシー:プライバシー保護度合いの汎用的・数学的な定義。データに対するクエリの出力に適切なノイズを付与することによって、統計的な有用性を維持したまま、数学的に証明可能なプライバシー保証を提供する。